Нейросеть Kandinsky 2.2, разработанная Сбером, научилась создавать анимации по текстовому запросу. Обновленный функционал находится на стадии ограниченного тестирования, но HTNews удалось получить доступ к инструментарию и традиционно протестировать возможности нейросети.

В апреле 2023 года Сбер представил нейросеть Kandinsky 2.1, которая генерировала изображение по его текстовому запросу. Редакция HTNews протестировала ту версию и пришла к выводу, что с некоторыми запросами нейросеть справлялась хорошо, с другими не очень.

Затем Сбер обновил нейросеть до версии Kandinsky 2.2, улучшив качество генерируемых изображений. Редакция HTNews так же провела тестирование, с результатами которого вы можете ознакомиться в нашем специальном материале. С момента релиза Kandinsky 2.2 пользователи нейросети сгенерировали 50 млн изображений.

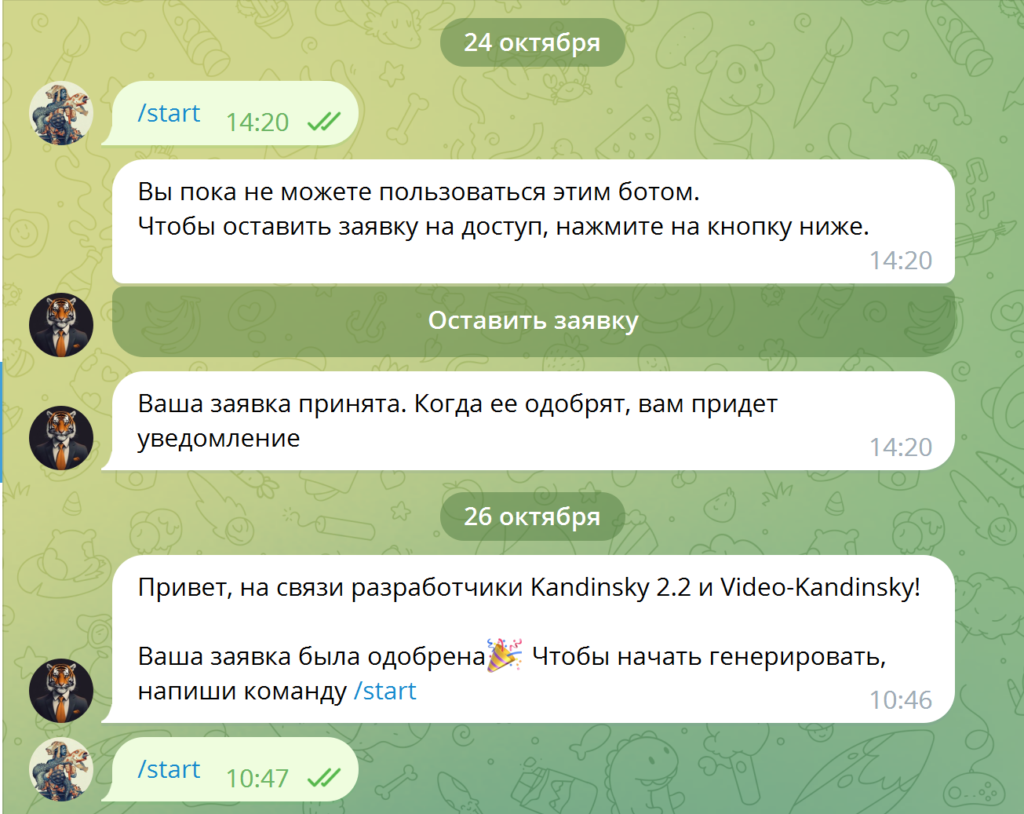

В октябре 2023 года Сбер анонсировал новые возможности Kandinsky 2.2. Помимо создания изображений обновленная нейросеть способна создавать короткие анимационные ролики. Пока видео генерируется только через телеграмм-бот Video-Kandinsky и в формате 640×640 пикселей, с частотой 24 к/с. Сейчас тестирование нового функционала доступно лишь самым активным пользователям нейросети, либо по приглашению, заявку на который надо отправить в телеграмм-бот.

После того как заявка HTNews была принята мы получили доступ к возможности генерировать анимированные ролики. Перед началом работы чат-бот так же провел краткий инструктаж о принципах работы новых функций.

Интерфейс максимально простой. В окно чата пользователь вводит текстовый запрос для создания желаемой анимационной сцены. Затем чат-бот предложит завершить ее или добавить еще два описания для создания дополнительных сцен. После того как вы закончите с описанием — надо будет выбрать движение камеры из нескольких предложенных вам.

Выбираем формат видео: квадратный, вертикальный или горизонтальный, после чего начаем генерацию видео. В зависимости от количества сцен и загруженности серверов, процесс может занять от одной минуты (если сцена только одна) и от трех минут, если вы задали три сцены.

Тестирование Video-Kandinsky предлагаю начать с простого запроса «Ароматный кофе«. Движение камеры было выбрано вверх, а формат видео — вертикальный.

Попробуем усложнить сцену добавив новые переменные: «Усатый повар готовит ароматный кофе«. Движение камеры осталось прежнее, а вот формат видео меняем на горизонтальное.

Как можно заметить по видео выше, у повара нет усов, да и кофе он готовит немного странно.

Попробуем задать еще один простой запрос. Например: «Рыжий котенок бегает за бабочкой«. Так же горизонтально, но попробуем теперь с отдалением камеры.

Очень милая анимация. Но я ждал другого, хотелось бы больше динамики. Повторяем запрос, ничего не меняя.

Уже лучше. Попробуем создать анимацию природного явления, например: «Закат на пляже«. Движение камеры выберем на удаление, а формат видео горизонтальный.

Результат получился неплохим на мой взгляд. Единственное что смущает, так то силуэты странных существ, но в остальном можно сказать, что похоже на то, что хотелось увидеть.

Способен ли Video-Kandinsky учитывать стиль генерации видео в запросе пользователя? Попросим нейросеть сгенерировать «Снегопад в лесу в аниме стиле«. Движение камеры — на приближение, а формат на этот раз квадратный.

Результат на мой взгляд получился просто впечатляющий. Да, конечно заметно, что частота кадров местами проседает и анимация идет рывками, но зато нейросеть смогла неплохо передать атмосферу.

Теперь в продолжение теста попробуем создать анимацию в которой будет сразу три сцены. Алгоритм действий тот же, только их количество увеличено в три раза. Первым запросом станет «Солнечный луг на котором пасутся кони» с приближением камеры.

Во второй сцене попросим изобразить «Солнечный луг затянуло тучами и лошади убежали» с удалением камеры. На третью сцену зададим запрос на «Из туч засверкали молнии, а на луг обрушился сильный дождь«, так же с удалением. Формат видео — горизонтальный.

Результат получился противоречивый. Тут и лошади странной формы, и погодные явления ни совсем натуральные, да и сам луг меняется в каждой сцене. Но при этом анимация в целом и очень приблизительно отображает заданный запрос.

Последующие запросы на создание сложных сюжетов из нескольких сцен давали примерно похожий результат. Получившиеся анимации имели недостатки как и отельных сцен, так и в выстраивание общих сцен.

Выводы

Video-Kandinsky — очень молодая нейросеть, которая, к тому же, находится на стадии закрытого тестирования. Ей еще многому предстоит научиться. А если рассматривать ее в качестве рабочего инструмента, а не забавного способа скрасить вечер, то учиться ей еще очень многому. Но иногда, среди множества попыток она способна выдать относительно неплохие результаты. Опираясь на них можно поймать вдохновение для создания собственных креативных идей.